SK hynix – Tirez le meilleur parti des SSD SATA et NVMe Enterprise – Serveur d’impression

Le stockage flash NVMe a pris d'assaut l'industrie, s'imposant comme la norme de facto lorsque le stockage hautes performances à faible latence est requis. Il y a cependant des moments où NVMe peut être exagéré, ou des cas où une approche flash hybride a plus de sens. De nombreuses solutions définies par logiciel sur serveur qui tirent parti du flash peuvent le faire dans une capacité à plusieurs niveaux. VMware vSAN et Microsoft Azure Stack HCI sont peut-être les plus connus de cette manière; les deux peuvent exploiter un petit pool flash haute performance pour la hiérarchisation et des SSD moins chers pour la capacité. La mise en mémoire tampon des SSD SATA à faible coût avec un petit nombre de NVMe offre un excellent mélange de performances, de capacité et de coût.

Le stockage flash NVMe a pris d'assaut l'industrie, s'imposant comme la norme de facto lorsque le stockage hautes performances à faible latence est requis. Il y a cependant des moments où NVMe peut être exagéré, ou des cas où une approche flash hybride a plus de sens. De nombreuses solutions définies par logiciel sur serveur qui tirent parti du flash peuvent le faire dans une capacité à plusieurs niveaux. VMware vSAN et Microsoft Azure Stack HCI sont peut-être les plus connus de cette manière; les deux peuvent exploiter un petit pool flash haute performance pour la hiérarchisation et des SSD moins chers pour la capacité. La mise en mémoire tampon des SSD SATA à faible coût avec un petit nombre de NVMe offre un excellent mélange de performances, de capacité et de coût.

Un autre facteur lorsque l'on envisage le déploiement de Flash est le serveur lui-même. Bien qu'il existe de nombreux serveurs entièrement NVMe de fournisseurs grands et petits, il est souvent difficile ou inutile de suivre cette voie. Le coût du lecteur NVMe étant supérieur à SATA, la majorité des serveurs vendus aujourd'hui offriront quelques baies NVMe, mélangées avec SATA / SAS pour le reste. Un tel serveur vendu de cette manière est le Dell EMC PowerEdge R640.

Le Dell EMC PowerEdge R640 est un serveur 1U à 2 sockets conçu pour les tâches où la densité de calcul est équivalente. Dans notre laboratoire, nous avons un R640 configuré avec 10 baies de disques de 2,5 pouces, dont 4 baies combo NVMe / SAS / SATA et 6 baies SAS / SATA, bien que Dell offre une grande variété de configurations. Ce type de configuration de stockage nous permet de tirer parti de jusqu'à quatre SSD NVMe très rapides, ainsi que de tirer parti des SSD SATA à coût optimisé. Les baies combinées permettent également aux clients d'aller plus loin sur les SSD NVMe à mesure que les besoins d'E / S augmentent ou restent avec plus de SATA ou SAS selon les exigences spécifiques de la construction.

Disque SSD SK hynix PE6011

Pour illustrer davantage ce concept, nous avons travaillé avec SK hynix pour tester un groupe de SS60 NVMe PE6011 et un groupe de SSD SE4011 SATA. Ces tests sont effectués pour montrer comment chaque disque peut compléter l'autre, avec NVMe offrant une plus grande bande passante et un potentiel d'E / S, et SATA offrant les exigences de capacité sans une baisse significative de la latence ou des performances. Les tests indiquent clairement où se situent les bandes de performances, de sorte que l'entreprise dispose d'une image complète pour faciliter le processus de prise de décision, en particulier lors de l'architecture de solutions définies par logiciel comme un magasin d'objets (SUSE Enterprise Storage) ou un dispositif de stockage virtuel plus traditionnel (StoreONE) .

Sommaire

SSD SATA vs NVMe – Banc d'essai Dell EMC PowerEdge R640

Dans notre configuration de test, nous avons utilisé un Dell PowerEdge R640 équipé de deux processeurs évolutifs 8280 Intel Xeon de 2e génération avec une vitesse d'horloge de 2,7 GHz et 28 cœurs chacun. Jumelés à ces processeurs, douze modules DDR4 de 32 Go à 2933 MHz ont donné au système une empreinte mémoire combinée de 384 Go. Pour la connectivité SATA, le R640 comprenait une carte RAID PERC H740P et des disques configurés en mode d'intercommunication HBA. Pour la connectivité NVMe, les quatre SSD communiquent avec le 2e processeur avec des voies PCIe directes, sans utiliser de commutateur PCIe à l'intérieur du R640. Cette méthode a ignoré l'impact du cache du contrôleur et s'est plutôt concentrée sur les performances des disques eux-mêmes, globalement ou individuellement dans VMware.

Dell EMC PowerEdge R640

Notre configuration de test consistait en deux configurations de stockage. Le premier était quatre SSD PE6011 NVMe, équipant entièrement les quatre baies NVMe à l'intérieur du PowerEdge R640, laissant six baies SATA / SAS restantes ouvertes. Le deuxième était huit SSD SE4011 SATA, utilisant pleinement toutes les baies SATA / SAS dédiées, laissant deux baies combo NVMe disponibles.

Pour les benchmarks en métal nu, nous avons utilisé CentOS 7.2 (1908) minimal, avec OpenJava installé avec vdbench. Nous avons mesuré chaque groupe de lecteurs dans leur ensemble, montrant les performances maximales de quatre SSD NVMe PE6011 et les suivants avec huit SSD SATA SE4011. Dans notre environnement de test virtualisé, nous avons installé VMware ESXi 6.7u3 et formaté des SSD individuels avec des banques de données et y avons placé des bases de données SQL Server ou MySQL. Pour les tests Sysbench, nous exploitons 8 VM, avec deux placées sur chaque SSD dans le cas des tests NVMe, une par SSD dans le cas des tests SATA. Pour SQL Server avec le test composé uniquement de 4 machines virtuelles, nous plaçons chacun sur son propre SSD, ce qui nous donne quatre SSD NVMe ou quatre SSD SATA en cours de test.

Test VDbench / nombre de threads

Tous ces tests exploitent le générateur de charge de travail vdBench commun, avec un moteur de script pour automatiser et capturer les résultats sur un grand cluster de tests de calcul. Cela nous permet de répéter les mêmes charges de travail sur une large gamme de périphériques de stockage, y compris les baies flash et les périphériques de stockage individuels.

Profils:

- Lecture aléatoire 4K: lecture 100%, 128 threads, 0-120% iorate

- Écriture aléatoire 4K: écriture 100%, 128 threads, iorate 0-120%

- Lecture séquentielle 64K: 100% lecture, 32 threads, 0-120% iorate

- Écriture séquentielle 64K: 100% écriture, 16 threads, 0-120% iorate

Configuration de SQL Server (4VM)

Le protocole de test OLTP de Microsoft SQL Server de StorageReview utilise la version actuelle du Benchmark C (TPC-C) du Transaction Processing Performance Council, une référence de traitement des transactions en ligne qui simule les activités trouvées dans des environnements d'application complexes. Le benchmark TPC-C est plus proche que les benchmarks de performances synthétiques pour mesurer les performances et les goulots d'étranglement de l'infrastructure de stockage dans les environnements de bases de données.

Chaque machine virtuelle SQL Server est configurée avec deux vDisks: un volume de 100 Go pour le démarrage et un volume de 500 Go pour la base de données et les fichiers journaux. Du point de vue des ressources système, nous avons configuré chaque machine virtuelle avec 16 processeurs virtuels, 64 Go de DRAM et exploité le contrôleur SCSI LSI Logic SAS. Alors que nos charges de travail Sysbench testées précédemment saturaient la plate-forme en termes d'E / S de stockage et de capacité, le test SQL recherche les performances de latence.

Ce test utilise SQL Server 2014 exécuté sur des machines virtuelles invitées Windows Server 2012 R2, et est souligné par Benchmark Factory for Databases de Dell. Bien que notre utilisation traditionnelle de cette référence ait été de tester de grandes bases de données à l'échelle 3000 sur le stockage local ou partagé, dans cette itération, nous nous concentrons sur la répartition uniforme de quatre bases de données à l'échelle 1500 sur nos serveurs.

Configuration de test de SQL Server (par VM)

- Windows Server 2012 R2

- Empreinte de stockage: 600 Go alloués, 500 Go utilisés

- SQL Server 2014

- Taille de la base de données: échelle 1500

- Charge du client virtuel: 15 000

- Mémoire tampon RAM: 48 Go

- Durée du test: 3 heures

- 2,5 heures de préconditionnement

- Période d'échantillonnage de 30 minutes

Configuration de MySQL Sysbench (8VM)

Notre base de données Percona MySQL OLTP mesure les performances transactionnelles via SysBench. Ce test mesure également le TPS moyen (transactions par seconde), la latence moyenne et la latence moyenne au 99e centile.

Chaque machine virtuelle Sysbench est configurée avec trois vDisks: un pour le démarrage (~ 92 Go), un avec la base de données prédéfinie (~ 447 Go) et le troisième pour la base de données en cours de test (270 Go). Du point de vue des ressources système, nous avons configuré chaque machine virtuelle avec 16 processeurs virtuels, 60 Go de DRAM et exploité le contrôleur SCSI LSI Logic SAS.

Configuration de test Sysbench (par VM)

- CentOS 6.3 64 bits

- Percona XtraDB 5.5.30-rel30.1

- Tables de base de données: 100

- Taille de la base de données: 10 000 000

- Fils de la base de données: 32

- Mémoire tampon RAM: 24 Go

- Durée du test: 3 heures

- 2 heures de préconditionnement 32 fils

- 1 heure 32 discussions

Résultats de performance SK hynix SATA et NVMe SSD

Pour caractériser les performances du SSD SK hynix PE6011 NVMe et du SE4011 SATA SSD, nous avons effectué une charge de travail synthétique aux quatre coins. Cela a comparé les performances brutes de quatre SSD NVMe à huit SSD SATA, toutes adressées directement pour une image d'E / S totale sans impact RAID sur les performances.

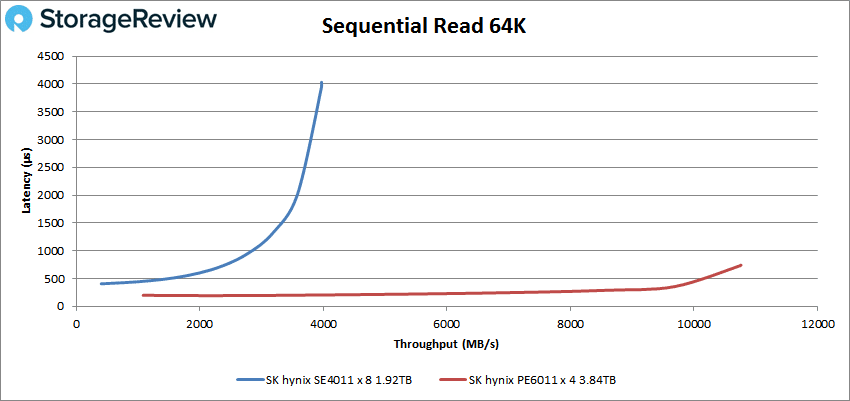

Notre première charge de travail a mesuré la bande passante de lecture maximale de chaque groupe de lecteurs avec une charge de travail séquentielle de 64 Ko. Dans cette charge de travail, nous avons mesuré une bande passante de pointe de 3,97 Go / s à une latence de 4 ms à partir du groupe SATA à huit disques. Le groupe NVMe à quatre disques a mesuré une bande passante maximale de 10,76 Go / s à 0,734 ms.

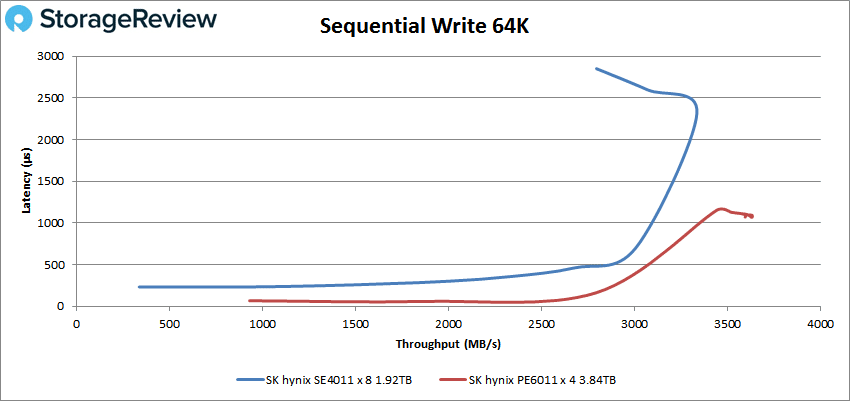

Ensuite, nous avons examiné la bande passante d'écriture séquentielle avec la même charge de travail séquentielle de 64 Ko. Dans ce cadre, le groupe SSD SATA a mesuré 3,06 Go / s à son pic, avant de retomber à 2,8 Go / s avec une latence de 2,8 ms à un point de sursaturation. Le groupe SSD NVMe a cependant évolué jusqu'à 3,6 Go / s avec une latence de 1,1 ms.

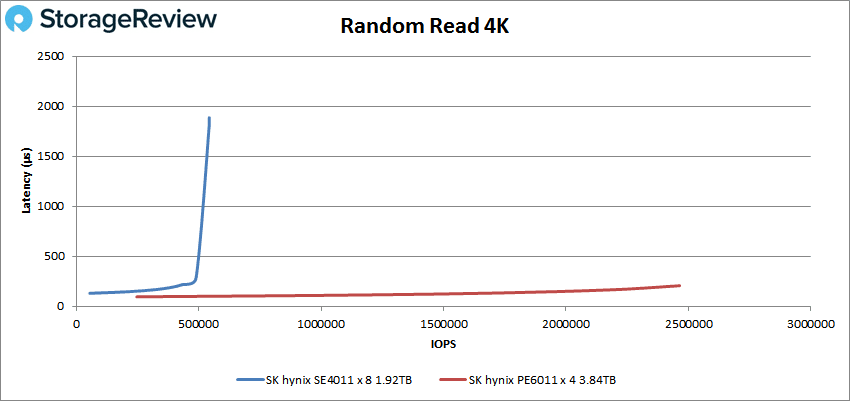

En mettant l'accent sur nos tests de débit de pointe mesurant les performances aléatoires 4K, nous examinons d'abord notre charge de travail en lecture. Dans ce cadre, le groupe de huit SSD SATA a culminé à 542 000 IOPS avec une latence de 1,9 ms. En comparaison, les quatre SSD NVMe ont pu les dépasser de loin avec un débit de pointe de 2,46 M IOPS avec une latence de 0,205 ms.

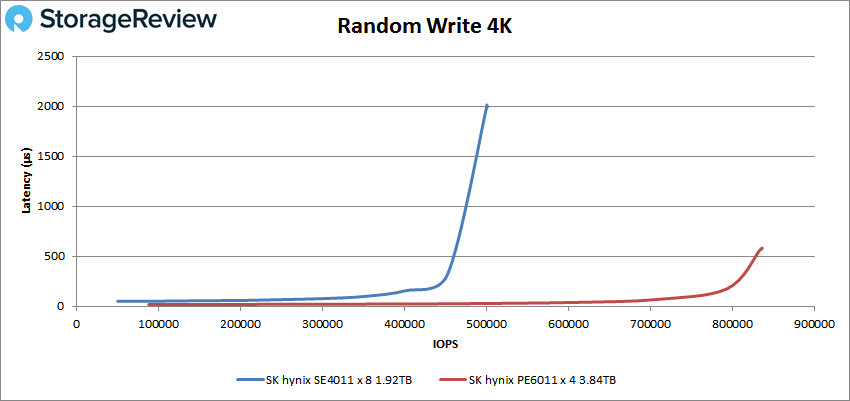

Le dernier composant de notre charge de travail synthétique «aux quatre coins» a mesuré les performances d'écriture aléatoire 4K de chaque groupe de lecteurs. Les huit SSD SATA ont pu offrir un pic de 500 k IOPS à une latence de 1,99 ms, tandis que les quatre SSD NVMe offraient 835 k IOPS à une latence de 0,572 ms.

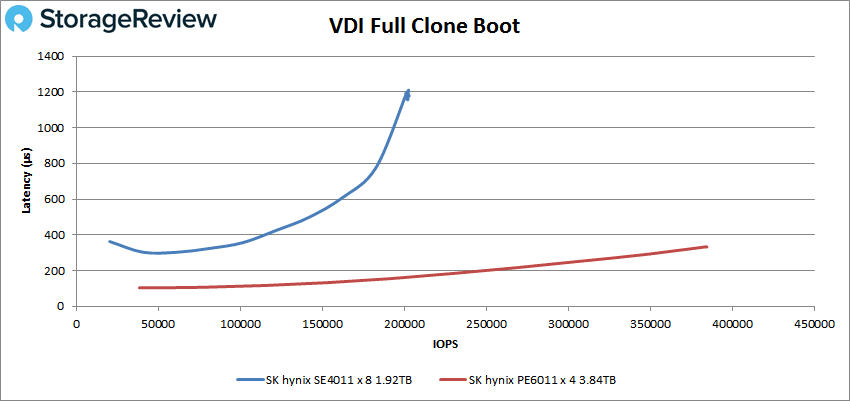

Dans la dernière étape de nos tests synthétiques, nous avons examiné deux cas d'utilisation VDI, le premier étant le démarrage VDI Full Clone. Dans cette charge de travail, les quatre SSD NVMe PE6011 offraient une bande passante de pointe de 384 000 IOPS ou 5,3 Go / s à une latence de 0,33 ms, tandis que les huit SSD SATA SE4011 SATA atteignaient un pic avec une bande passante de 202 000 IOPS ou 2,8 Go / s à une latence de 1,2 ms.

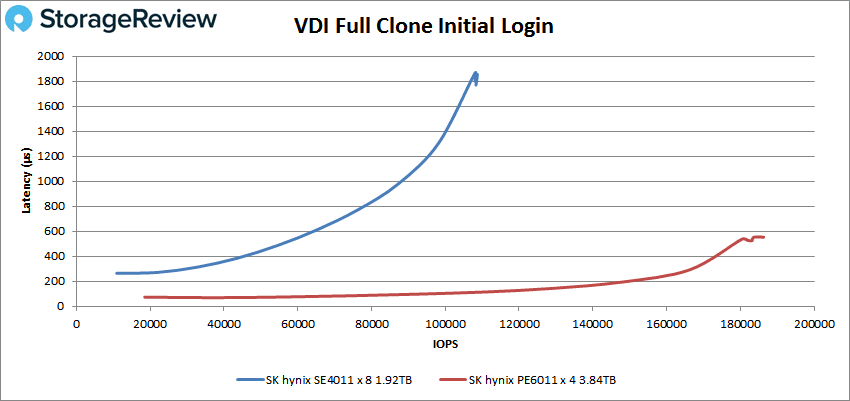

En mesurant les performances des SSD NVMe PE6011, nous avons constaté une bande passante maximale de ce groupe atteignant 186 kOPS ou 3,5 Go / s à 0,55 ms. Le groupe SATA à huit disques mesurait plus de 109 000 IOPS ou 2,1 Go / s à une latence de 1,9 ms.

En examinant les performances de chaque groupe de disques dans nos charges de travail à quatre coins et VDI, nous constatons qu'un rapport 2: 1 entre SATA et NVME offrait un bon équilibre entre les performances de lecture et d'écriture. Les SSD PE6011 ont pu offrir un débit de lecture et une bande passante très élevés à faible latence par rapport à leurs homologues SATA. En ce qui concerne le débit d'écriture et la bande passante, les SSD SE4011 ont pu absorber des charges de travail pas trop loin derrière leurs homologues NVMe, ce qui est important lors de la combinaison de différentes classes de disques dans une solution de stockage où les données doivent se déplacer entre les niveaux assez rapidement sans ralentir les charges de travail entrantes .

Nos deux dernières charges de travail examinent les performances de Microsoft SQL Server TPC-C et MySQL Sysbench exécutées sur plusieurs machines virtuelles dans un environnement virtualisé VMWare ESXi 6.7u3. Ces deux tests sont conçus pour montrer les performances du monde réel, notre charge de travail SQL Server se concentrant sur la latence et notre test MySQL sur les performances transactionnelles maximales.

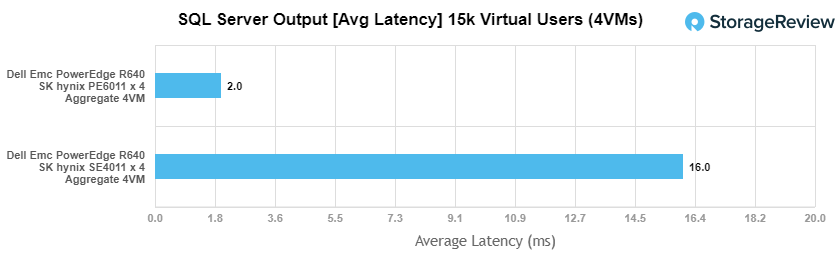

Notre charge de travail SQL Server pour ce projet consistait à tester 4 machines virtuelles, chacune placée dans une seule banque de données VMFS 5. Cette charge de travail a exploité quatre des SSD NVMe SK hynix PE6011 et quatre SSD SE4011 SATA. À l'aide de Quest Benchmark Factory, chaque machine virtuelle a un utilisateur virtuel de 15 000 appliqué et la réactivité de la base de données est mesurée.

Sur les quatre SSD SK hynix PE6011 NVMe, nous avons mesuré une latence moyenne de 2 ms sur les quatre machines virtuelles. Le déplacement de cette même charge de travail vers les quatre SSD SATA SE4011 s'est accéléré à une moyenne de 16 ms.

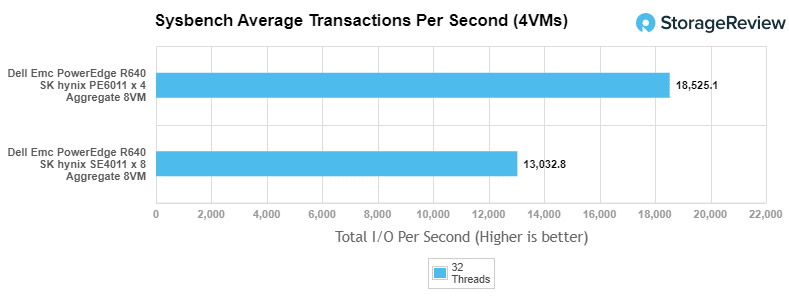

Dans notre charge de travail de base de données finale, nous avons examiné les performances de 8 machines virtuelles. Avec 8 VM, nous en plaçons deux sur chacun des 4 SSD NVMe et un sur chacun des 8 SSD SATA. Dans cette charge de travail, nous mesurons les performances transactionnelles individuelles de chaque machine virtuelle et les agrégons ensemble pour un score total.

Sur les quatre SSD SK hynix PE6011 NVMe, nous avons mesuré un total de 18 525 TPS à une latence moyenne de 13,81 ms. En déplaçant cette charge de travail vers les huit SSD NVMe SK hynix SE4011, l'agrégat mesurait 13 032 TPS à une latence moyenne de 19,64 ms.

SSD SATA vs NVMe – Final Pensées

Lorsque vous envisagez toute forme de stockage, il est essentiel de comprendre les caractéristiques de performance, de coût et de capacité du système considéré. Dans ce cas, nous examinons un portefeuille diversifié de SSD de SK hynix, qui est capable de répondre à une offre presque infinie de cas d'utilisation. Parce que SK hynix propose des SSD SATA et NVMe, les disques peuvent être exploités de différentes manières. Bien que les SSD NVMe soient clairement rapides, ils ont un prix supérieur à SATA. D'autre part, les SSD SATA abandonnent la vitesse offerte par NVMe, mais sont plus économiques et attrapent toujours le vent arrière de tous les avantages du flash TCO sur les disques durs. À ce titre, la majorité des entreprises peuvent bénéficier d'une approche flash hybride, combinant les performances de NVMe, avec l'économie favorable de SATA.

Nulle part cette opportunité n'est plus claire que dans le stockage défini par logiciel et le marché de l'hyperconvergence. La plupart des déploiements SDS et HCI sont conçus pour tirer parti de différentes classes de stockage; StoreONE, Microsoft Azure Stack HCI et VMware vSAN en sont tous de bons exemples. Dans certains cas, les SSD NVMe peuvent faire office de cache ou de niveau devant les disques SATA, qui servent de capacité au système. Dans d'autres cas, des pools distincts peuvent être créés, dans ce cas, un pool de performances de NVMe et un pool SATA pour les charges de travail d'application moins critiques.

Pour illustrer les avantages des deux types de SSD, nous avons testé un groupe de SSD NVMe PE6011 ainsi que des SSD SATA SE4011 dans un Dell EMC PowerEdge R640. Nos principales constatations montrent que les SSD NVMe PE6011 sont capables de fournir des performances solides et à faible latence sur l'ensemble de nos charges de travail synthétiques et applicatives, fournissant plus de 10,7 Go / s en bande passante en lecture. De plus, nos résultats montrent que les SSD S4011 SATA complètent les SSD NVMe, offrant un niveau de capacité stable dans toutes nos charges de travail, ce qui est un facteur important dans les scénarios de hiérarchisation ou de mise en cache où les données peuvent reposer sur l'un ou l'autre pool de stockage. Les performances d'écriture sur le groupe SATA SE4011 ont très bien résisté, mesurant 2,8 Go / s sur huit disques, contre 3,6 Go / s pour quatre disques SSD PE6011 NVMe. Au fur et à mesure que les charges de travail se dégradent ou doivent bien fonctionner avant de passer au cache ou à la hiérarchisation, de fortes performances d'écriture leur permettent d'offrir une expérience utilisateur cohérente pour une solution de stockage bien équilibrée.

SK hynix a redoublé d'efforts dans le flash d'entreprise au cours des 18 derniers mois, arrivant rapidement sur le marché avec un portefeuille diversifié et intégré verticalement. Cette gamme de produits offre aux clients des choix pour garantir que leurs déploiements se déroulent comme prévu. Que les disques entrent dans une solution SDS, un cluster HCI ou servent simplement de stockage de serveur, SK hynix est prêt à soutenir leurs clients dans cette aventure.

SSD Sk hynix Enterprise

Discutez sur Reddit

S'engager avec StorageReview

Newsletter | YouTube | Podcast iTunes / Spotify | Instagram | Twitter | Facebook | Flux RSS

Ce rapport est parrainé par SK hynix. Toutes les vues et opinions exprimées dans ce rapport sont basées sur notre vision impartiale du ou des produits à l'étude.

Commentaires

Laisser un commentaire